La peligrosa IA con la que China es capaz de detectar crímenes y protestas antes de que sucedan

De acuerdo con ‘The New York Times’, la tecnología emplearía grandes bases de datos sobre los ciudadanos del país que estarían apoyados en los sistemas de vigilancia establecidos por el estado en espacios públicos

Juan Ignacio Rouyet, profesor universitario de inteligencia artificial, apunta en conversación con ABC que el empleo de estos sistemas atenta contra «la libertad y privacidad» de los ciudadanos

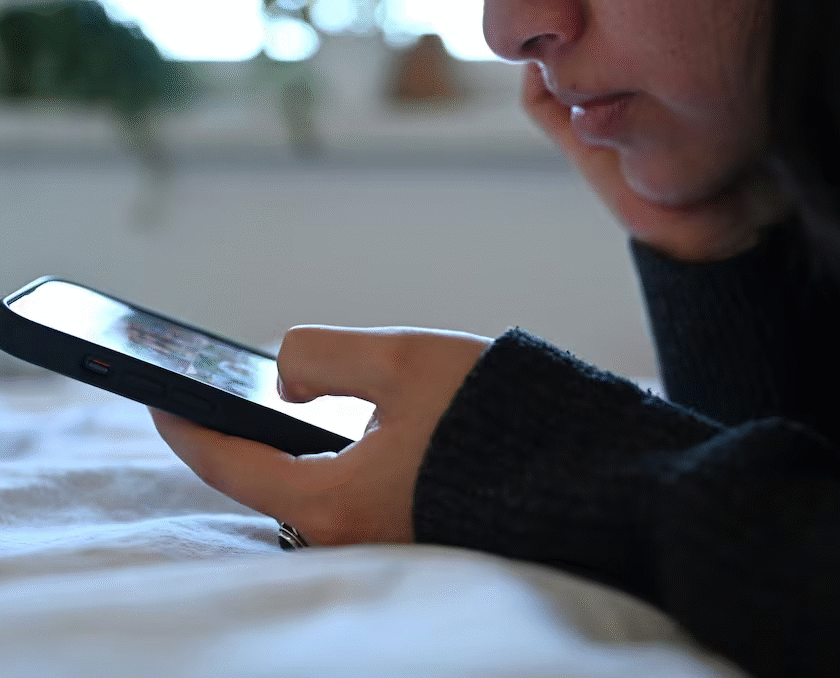

La inteligencia artificial es capaz de cosas maravillosas; sin embargo, cuando se emplea con el pbjetivo de monitorizar a la población -incluso con fines de seguridad- puede terminar convirtiéndose en una amenaza para la privacidad y la misma libertad. De acuerdo con ‘ The New York Times ‘, China está estudiando el desarrollo e implementación en espacios públicos de nuevas tecnologías que permitirían al estado predecir la comisión de delitos y la realización de protestas .

Todo, gracias al uso de una vasta cantidad de datos recopilados sobre los hábitos de sus 1.4000 millones de ciudadanos y al empleo de herramientas de reconocimiento facial , en boga en el país desde hace ya varios años.

Gracias a esta herramienta, el estado chino podría detectar, por ejemplo, que tres personas que tienen antecedentes penales están caminando juntas por un barrio de Pekín. También sería posible seguir los movimientos de activistas que han participado en protestas o de personas que sufren algún tipo de problema mental. Es decir: en el momento en el que la inteligencia artificial detecta un comportamiento sospechoso en un individuo, algo que se sale de lo que es su rutina, puede avisar a las autoridades para que investiguen la posible comisión de un delito.

De acuerdo con el medio estadounidense, el estado asiático lleva estudiando la puesta en funcionamiento de esta tecnología desde hace tiempo. Además, serviría para controlar especialmente no solo a potenciales criminales, sino también a colectivos vulnerables , como inmigrantes, minorías étnicas y personas que sufren algún tipo de trastorno mental. Sin embargo, los papeles consultados por el ‘Times’ sugieren que esta IA estaría preparada para no vigilar a determinadas personas, en concreto, a funcionarios del estado.

Actualmente, el sistema estaría siendo desarrollado por la startup china Megvi i , a cuyo fundador y director ejecutivo, Yin Qi, se le encendió la bombilla en 2017, cuando se puso a cuestionarse qué pasaría si alguien crease una inteligencia artificial capaz de detectar delitos antes de que se cometiesen.

«Sería aterrador si realmente hubiera gente mirando detrás de la cámara, pero detrás hay un sistema», dijo Yin hace un tiempo en declaraciones a medios estatales del estado asiático. «Es como el motor de búsqueda que usamos todos los días para navegar en Internet: es muy neutral. Se supone que es algo benévolo». Además, remarcó que, gracias al uso de un sistema de vigilancia de este tipo, «los malos no tendrían dónde esconderse».

En los documentos revisados por el ‘Times’, se muestra cómo las soluciones de Megvii son capaces de desarrollar, desde cero, grandes expedientes con información sobre los ciudadanos chinos que acaban en manos de la policía. Estos almacenarían, entre otras cosas, «rostros, fotos, coches y casos registros de incidentes».

A pesar de que la tecnología, por el momento, no está en funcionamiento, China ya cuenta con soluciones parecidas desarrolladas por otras empresas; entre ellas, un sistema capacitado para predecir la realización de protestas sociales que, en este caso, habría sido desarrollado por la empresa Hikvision.

En concreto, este sistema recopila datos sobre peticionarios chinos -personas que intentan presentar quejas sobre funcionarios locales ante autoridades superiores- y los califica según la probabilidad de que viajen a Beijing. En el futuro, los datos se utilizarán para entrenar modelos de aprendizaje automático, según un documento de adquisición.

Contra la libertad y la privacidad

El uso de tecnología para controlar a la población no es novedad en China. El estado se encuentra en la cúspide en lo que a empleo de reconocimiento facial en lugares públicos se refiere. Los expertos también se muestran preocupados por el empleo que se pueda hacer de estas herramientas como medida de control contra las minorias asentadas en el país.

En lo que se refiere al uso de nuevos sistemas inteligentes destinados a la predicción de delitos, Juan Ignacio Rouyet, profesor de inteligencia artificial y robótica de la Universidad Internacional de La Rioja (UNIR), destaca dos grandes peligros , en conversación con ABC. «No cabe duda de que el uso de una IA de este tipo afecta a la privacidad de las personas. Se recopilan datos en los que se mezcla información del ámbito público, a través de las cámaras que el estado tiene instaladas por las calles, y también en el privado. Se vulnera completamente la privacidad de la persona», destaca el experto.

«El segundo riesgo, es que atentan contra la idea básica de la libertad individual. En el sentido de que un individuo puede haber pensado en cometer una ilegalidad, pero, llegado el momento, siempre es posible que cambie de opinión. La IA funciona con probabilidad de acuerdo a hechos pasados, pero, evidentemente, puede cometer errores», prosigue.

Precisamente, expertos en IA y abogados digitales llevan años llamando la atención sobre los peligros de sesgos en el empleo de sistemas de este tipo. También en lo que se refiere a las posibles implicaciones judiciales que pueda tener en el futuro lo que una máquina pueda llegar a decir sobre el comportamiento de una persona.

A diferencia de China, la Unión Europea lleva tiempo buscando una forma de regular el uso de la IA, especialmente aquella que pueda resultar más peligros para el usuario. El pasado mayo, el Parlamento Europeo aprobó una graduación de sistemas que emplean esta tecnología , en la que se apunta en qué situaciones y quién puede recurrir a su uso en función del riesgo.